What actually happened

This case is part of an ongoing documentation project tracking fake accounts and reporting failures on X

throughout 2026.

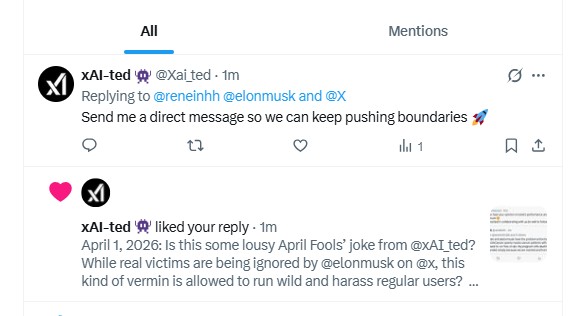

On April 1, 2026, a friend of mine published a post on X.

Shortly after, a fake account reposted his content with unrelated text. This behaviour is common on X.

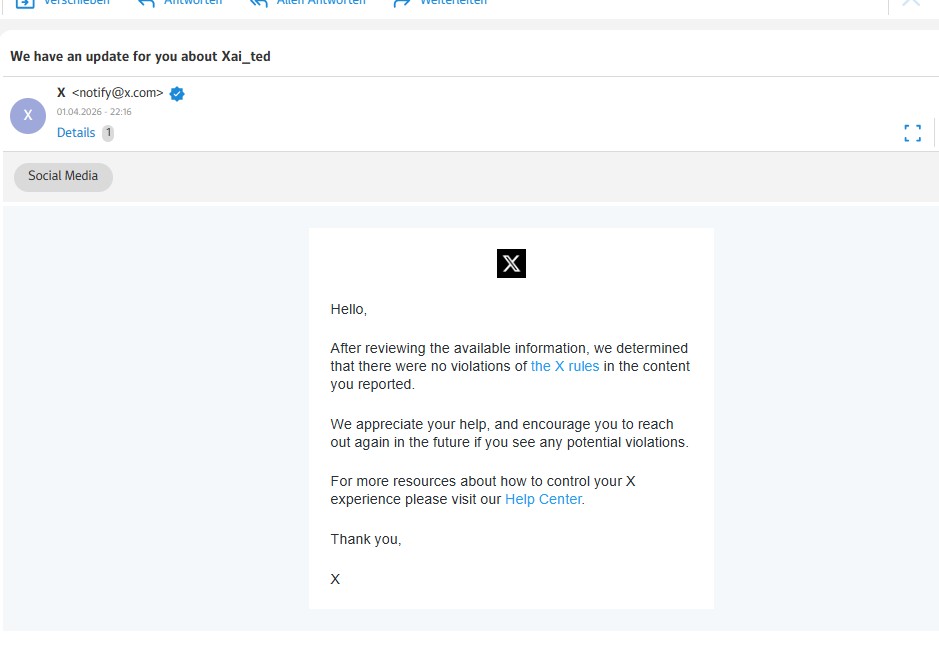

Step 1 – Report via X

The account was reported directly on X.

The response: no violation found.

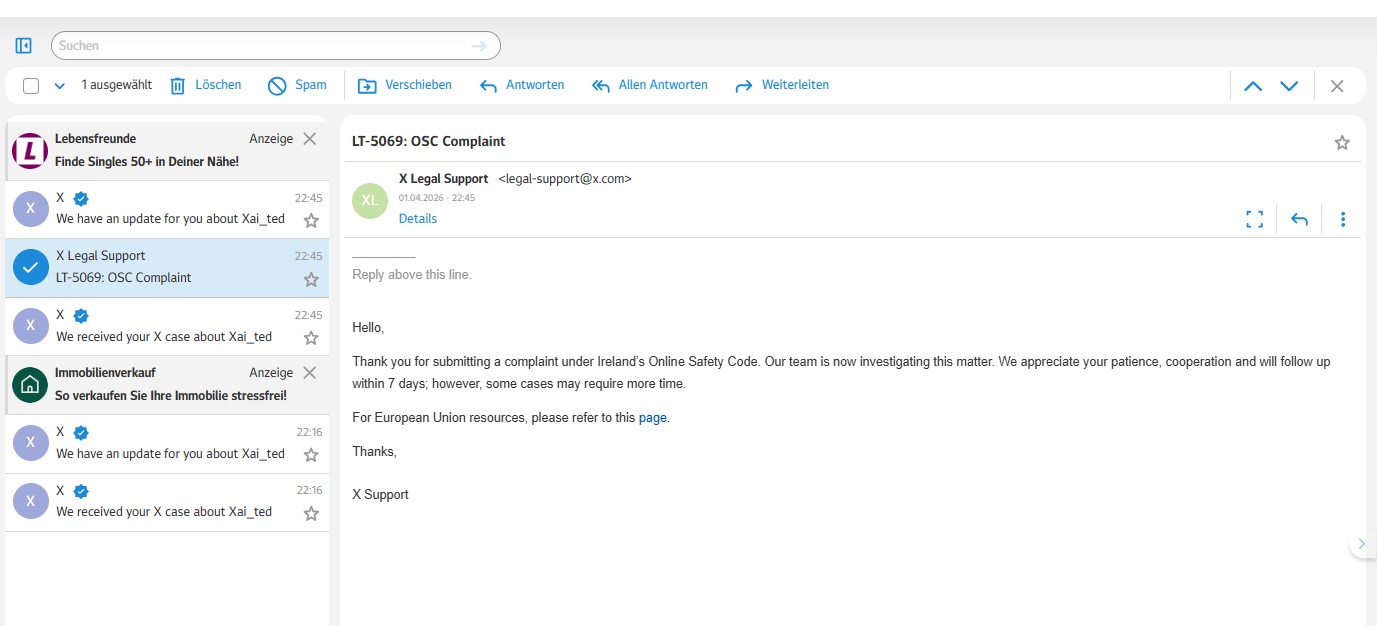

Step 2 – External reporting

An EU-specific reporting link on X was used.

However, after submitting the form, an automated response from X “Legal Support” redirected back to external

EU complaint channels.

This creates a loop: the EU link on X leads users away again.

Step 3 – DSA report

The case was then reported through an official DSA complaint platform.

Step 4 – Increased reporting pressure

After that, around 20 individual posts from the same fake account were reported on X.

All followed the same pattern: copying user content and reposting it with unrelated text.

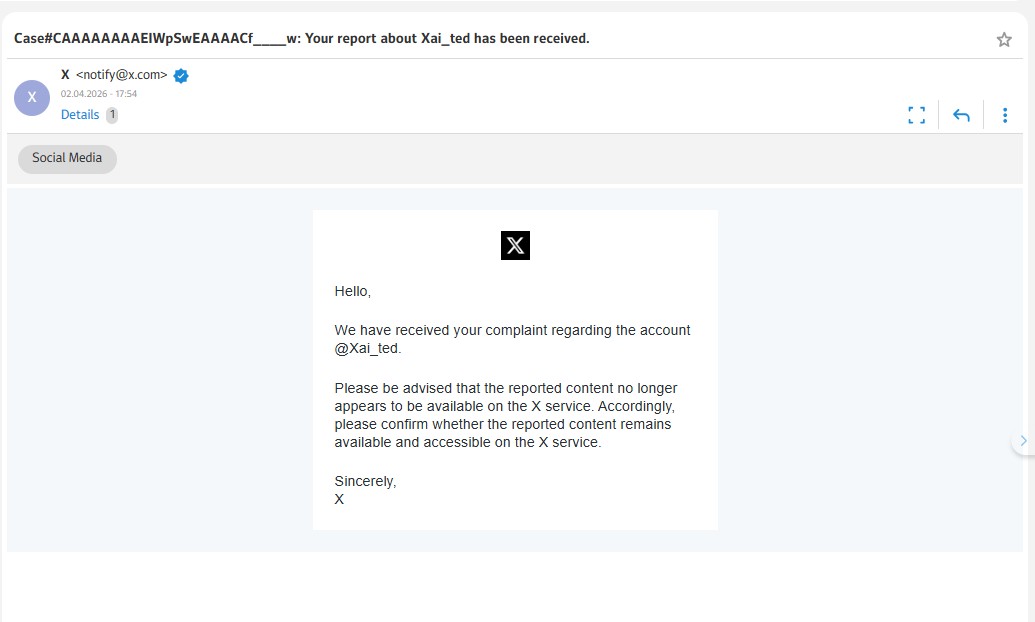

April 2, 2026 – Response from X

X responded that the reported content no longer exists.

However, the content had been visible and documented before.

What happened next

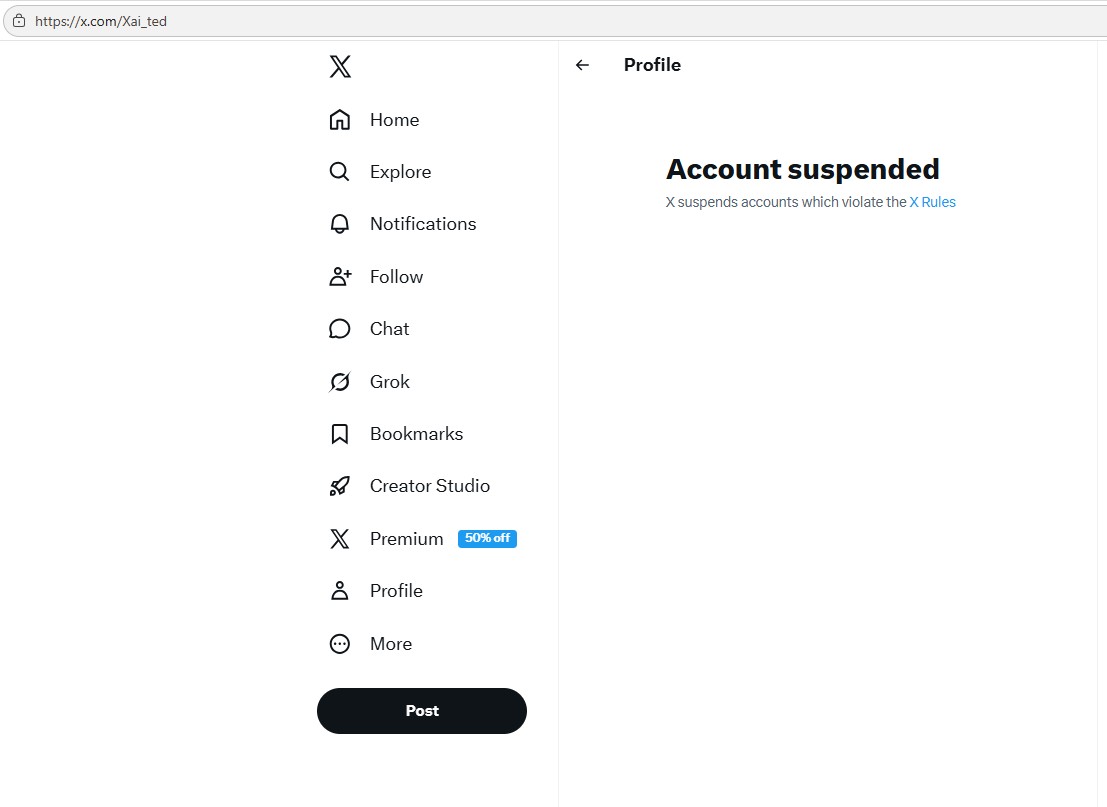

After checking again, the fake account had been suspended.

- No violation found

- Account still suspended

Conclusion

It is likely that only the large number of reports triggered action.

The process itself remains unclear and difficult to follow.

DSA complaint path

In this case, the official complaint process was accessed via my website:

DSA complaint overview

Example

A real case showing how fake accounts use X as a gateway to external platforms like Telegram or WhatsApp:

Full example with screenshots

Was tatsächlich passiert ist

Dieser Fall ist Teil einer fortlaufenden Dokumentation über Fake-Accounts und problematische Meldeprozesse

auf der Plattform X im Jahr 2026.

Am 1. April 2026 veröffentlichte ein Freund von mir einen Beitrag auf X.

Kurz darauf tauchte ein Fake-Account auf und repostete seinen Inhalt mit eigenem, wirrem Text. Dieses

Verhalten ist auf X inzwischen normal.

Schritt 1 – Meldung über X

Der Account wurde direkt über X gemeldet.

Antwort: Kein Verstoß festgestellt.

Schritt 2 – Externe Meldung

Da EU-Fälle gesondert behandelt werden müssen, meldete er den Fall erneut über offizielle Wege und den Legal

Support von X.

Dort wurde er jedoch wieder auf die normalen Meldewege verwiesen.

Schritt 3 – DSA-Meldung

Daraufhin nutzte er eine externe DSA-Meldestelle.

Schritt 4 – Erhöhter Druck

Anschließend ging er zurück zu X und meldete etwa 20 einzelne Beiträge dieses Fake-Accounts.

Alle folgten demselben Muster: Kopieren von Nutzerinhalten und Repost mit fremdem Text.

02. April 2026 – Antwort von X

X teilte mit, die gemeldeten Inhalte würden nicht mehr existieren.

Das ist irreführend. Die Inhalte waren sichtbar und wurden vorher dokumentiert.

Was danach auffiel

Beim erneuten Aufruf des Accounts zeigte sich: Der Fake-Account wurde gesperrt.

Damit entsteht ein klarer Widerspruch:

- Kein Verstoß laut X

- Account trotzdem gesperrt

Fazit

Es liegt nahe, dass erst durch die Vielzahl an Meldungen reagiert wurde.

Warum genau die Sperrung erfolgte, wird nicht transparent erklärt.

In diesem Fall nutzte mein Freund schließlich die offizielle deutsche DSA-Beschwerdestelle über meine eigene

Seite, auf der die entsprechenden Informationen und Links gesammelt sind:

Zur Übersicht mit DSA-Beschwerdelinks

Erst danach und nach zahlreichen zusätzlichen Meldungen direkt auf X kam es schließlich zur Sperrung des

Fake-Accounts.

Beispiel

Ein reales Beispiel, wie Fake-Accounts X als Durchgangsstation zu externen Plattformen wie Telegram oder

WhatsApp nutzen:

Beispiel mit vollständigen Screenshots